Уже несколько лет, особенно с популяризацией ChatGPT, мы слышим о искусственном интеллекте (сокращённоИИ на итальянском или AI на английском), который стал важной темой инвестиций, в том числе в управлениикапиталом.

Мы считаем, что это революция, которую пока рано называть «радикальной», но она, безусловно, не будетмимолётной модой. Особенно в финансовой сфере мы заметили, что термин AI полностью вытеснил термин Machine Learning (ML), который ранее часто звучал как инструмент для построения инвестиционных стратегий. Поэтому нам кажется уместным спросить, куда делся ML и каково его соотношение с AI.

Мы ответим на этот вопрос небольшим историческим экскурсом, который, надеемся, будет интересен и поможетлучше понять концепции AI и ML. В этом экскурсе мы изложим некоторые идеи, но – учитывая сложность темы – будем намеренно говорить в общих чертах, стараясь передать интуицию, а не строгие научные детали. ML означает обучение на основе статистики с помощью вычислительной машины (компьютера, по сути).

Существуетмножество вычислительных моделей для достижения этого результата, одна из которых – искусственныенейронные сети (Artificial Neural Network, ANN). Термин AI, вероятно, появился благодаря попыткамформализовать процесс человеческого обучения (или обучения млекопитающих в целом) с помощью простойматематико–статистической модели, основанной на упрощённом воспроизведении структуры и работычеловеческого мозга. Мозг состоит из триллионов нейронов, которые общаются посредством электрическихимпульсов, расшифровываемых синапсами и передающих химические сигналы (нейромедиаторы) другимнейронам. В зависимости от «силы» сигнала нейрон может активироваться и передать сигнал дальше по плотнойнейронной сети. Синапсы отвечают за обучение, поскольку схожие переживания активируют одинаковыенейронные пути.

Одной из первых моделей, пытавшихся воспроизвести эту морфологию и её работу, был персептрон Розенблатта(1962) с одним слоем нейронов. Позже благодаря методам обучения нейросети появились модели с несколькимислоями. Каждый узел (имитирующий «нейрон») ANN выполняет вычисления и передаёт их следующему наборуузлов с весовым коэффициентом (аналогом «синапса»). Обучение состоит в подаче входных данных(изображения, тексты, временные ряды и т.д.) для настройки параметров модели так, чтобы выходные данныебыли максимально близки к реальным (минимизируя ошибку). После обучения ANN способна обобщать: нановые входные данные выдавать корректный результат с высокой вероятностью.

Наиболее распространённым методом настройки параметров является обратное распространение ошибки(backpropagation), но оно выявило недостаток: оно придавало слишком большой вес параметрам последнего слоя, делая предыдущие слои незначимыми. ANN с одним слоем могли решать лишь задачи ограниченной сложности. Поэтому со временем они потеряли популярность, уступив место другим ML-моделям, таким как методы ядра(kernel methods).

Однако в 2010-х годах возродился интерес к нейронным сетям благодаря появлению новых моделей ANN, использованию графических процессоров (GPU) для параллельных вычислений и росту объёмов данных. Такродился глубокий нейросетевой анализ (Deep Learning, DL), который привёл к решению крайне сложных задач судивительными приложениями, такими как создание осмысленных текстов (а также изображений, звуков и т.д.), известное как генеративный искусственный интеллект (Generative AI). Возросшая вычислительная мощностьсделала возможной настройку миллиардов параметров многослойных нейронных сетей. Это объясняет успех NVIDIA, которая благодаря своим процессорам нового поколения Hopper, а затем Blackwell достигла нынешнеготехнологического превосходства.

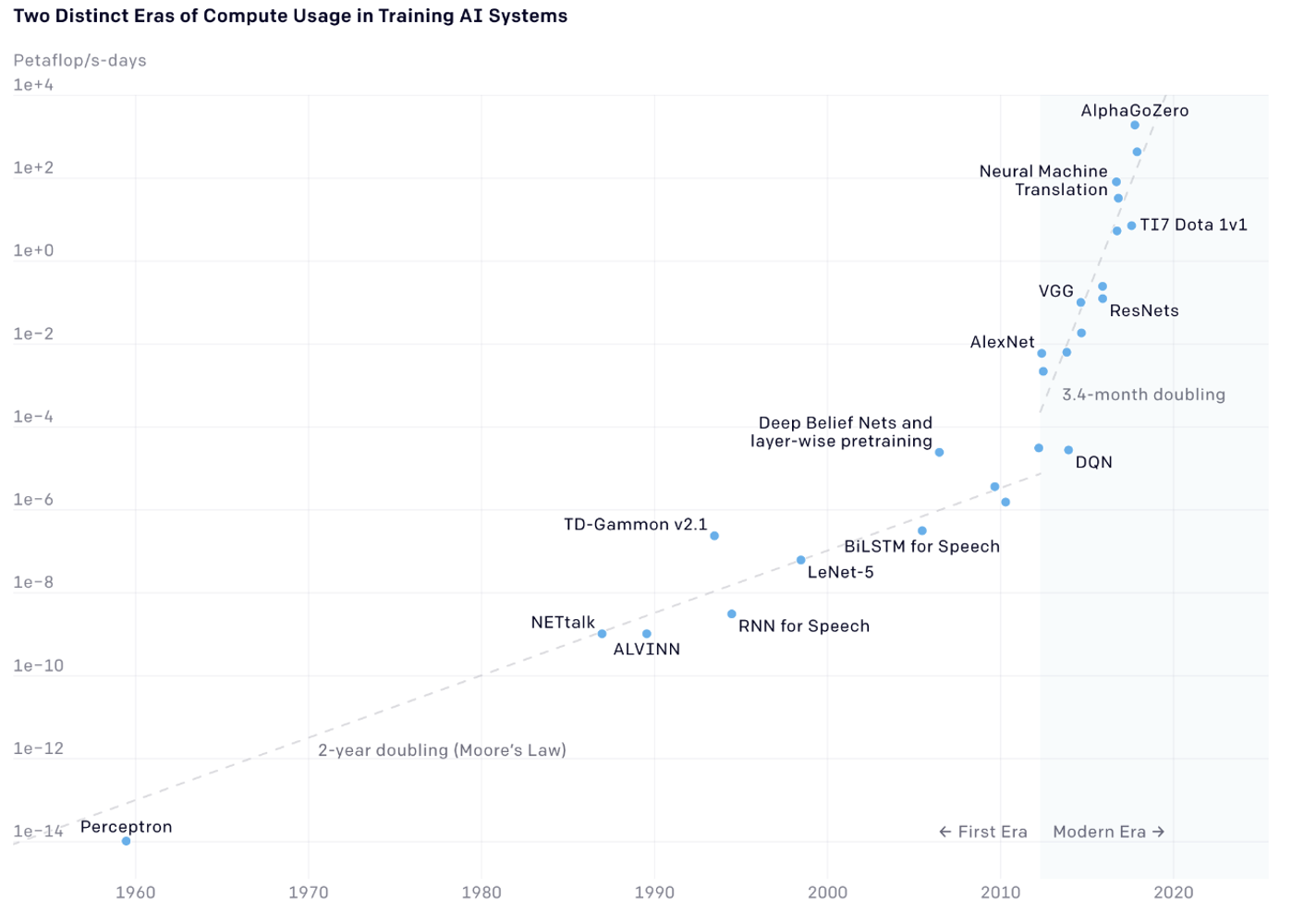

Чтобы показать рост вычислительных возможностей, приведём график с сайта OpenAI, где представлена – длянаглядности – логарифмическая шкала, отражающая экспоненциальный рост производительности процессоров с1960 года.

На графике показан рост вычислительных циклов процессоров, необходимых для работы различных моделей ML, считавшихся передовыми в своё время. Удивительно, что если до 2010 года частота процессоров удваивалась каждые 18 месяцев (закон Мура), то с 2010 года этот период сократился до трёх-четырёх месяцев.

В заключение можно считать AI частью ML или использовать эти термины как синонимы: мы осознаём, что это нестандартная точка зрения, поскольку обычно ML рассматривают как подмножество AI. Важно понимать, что речь идёт о новом научном и прикладном подходе, обладающем повсеместным характером и влияющим на все отрасли экономики. Это тема инвестиций, которая будет ключевой в ближайшие годы.

Дисклеймер: Данная статья выражает личное мнение сотрудников Custodia Wealth Management, которые её подготовили. Она не является инвестиционным советом, персональной консультацией и не должна рассматриваться как призыв к совершению финансовых операций.